Die KI Werkstatt hat ein Vorgehensmodell zur Einführung generativer KI erstellt und unterstützt KMU bei der Identifikation, betriebswirtschaftlichen Bewertung, Auswahl einer technischen Lösung und Pilotierung von Use Cases generativer KI.

Titel des Projektes:

Generative KI für KMU

Ansprechpartner:

Prof. Dr. Stefan Wittenberg, Prof. Dr. Christina Kratsch, Prof. Dr. Erik Rodner, Prof. Dr. Andre Beinrucker, Kilian Sanchez Holguin, Claudia Tyborski, Dr. Nina Siedler, Isabel Win, Marc Naumann

Haben Sie Fragen zur Einführung generativer KI in Ihrem Unternehmen?

Wir bieten Ihnen eine offene Sprechstunde der KI-Werkstatt informieren.

wann: jeden Freitag, 13-14 Uhr per Anmeldung unter https://calendly.com/stefan-wittenberg/ki-sprechstunde

wo: per Zoom unter https://htw-berlin.zoom-x.de/j/61221380518

wer: Prof. Dr. Stefan Wittenberg und Prof. Dr. Andre Beinrucker

Die KI-Werkstatt hat Vorgehensmodell für den Einsatz generativer KI entwickelt, mit Unternehmen aus Berlin validiert

und iterativ weiterentwickelt. Das Pilotprojekt wurde mit den Unternehmen Finetech GmbH & Co. KG und der NBB Netzgesellschaft Berlin-Brandenburg mbH & Co. KG (Gasag Gruppe) durchgeführt.

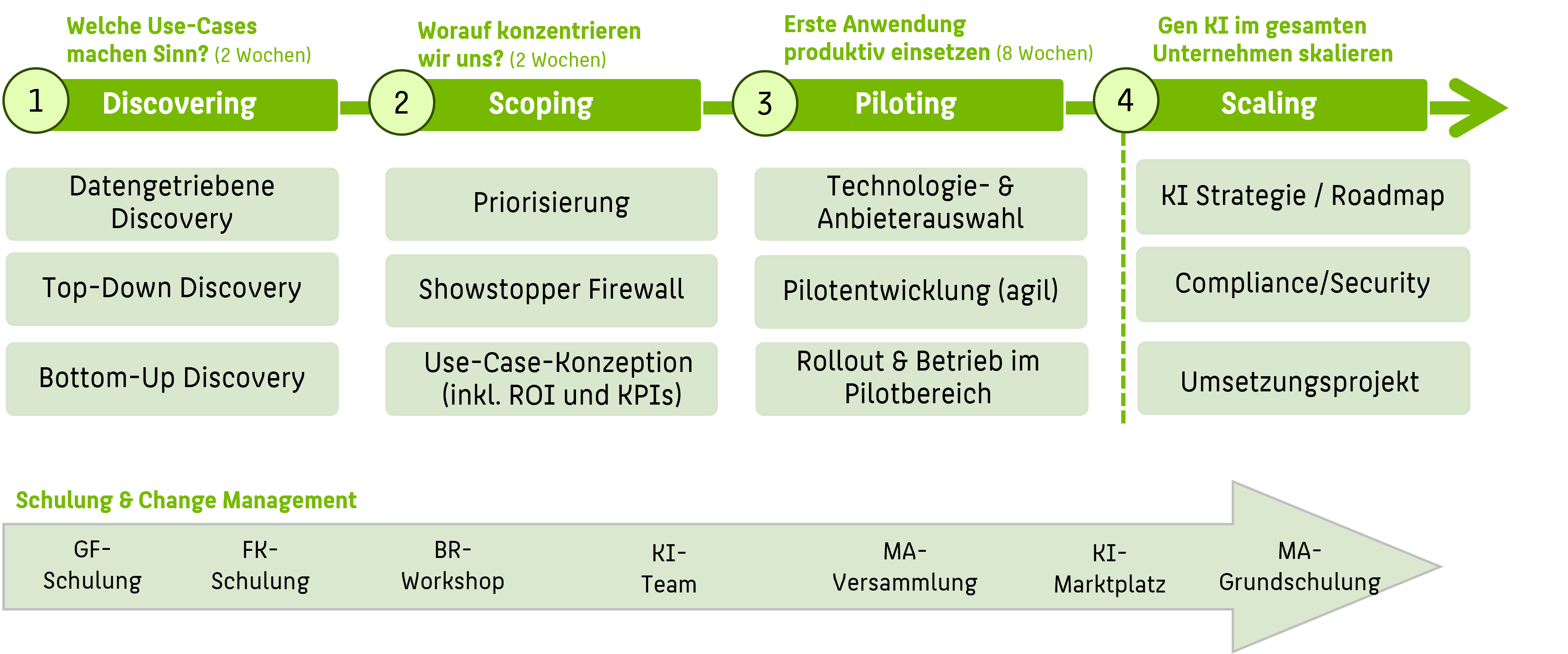

Das Vorgehensmodell besteht aus vier Phasen mit einzelnen Unterphasen:

1. Discovering-Phase:

2. Scoping-Phase:

3. Piloting-Phase:

4. Scaling-Phase:

Schulungs- und Change-Maßnahmen:

Diese Maßnahmen begleiten alle Phasen und beginnen mit der Schulung der Geschäftsführung, um sie mit den Möglichkeiten und Grenzen der KI vertraut zu machen. Anschließend werden Führungskräfte und der Betriebsrat einbezogen. Es wird ein abteilungsübergreifendes KI-Team aufgebaut, und durch Mitarbeiterveranstaltungen sowie den KI-Marktplatz wird für eine offene Kommunikation und Partizipation gesorgt. Vor dem flächendeckenden Rollout findet schließlich eine verpflichtende Mitarbeiterschulung statt, um alle auf den neuesten Stand zu bringen.

-> Die KI-Werkstatt unterstützt schwerpunktmäßig in den Phasen Discovering, Scoping und Piloting. Hier freuen wir uns über die Vermittlung von Studierenden für Abschlussarbeiten und Pratika. Auf Anfrage stehen wir Unternehmen im Rahmen von Auftragsforschungsprojekten auch unterstützend zur Verfügung.

Im Kern der Identifikation von Use-Cases für generative KI steht die Verbindung eines Top-Down mit einem Bottom-Up-Ansatz.

Im Top-Down Ansatz wird die Managementperspektive eingenommen und es werden aus Sicht des Geschäftsmodelles und einer datenbasierte Analyse mögliche Use-Cases abgeleitet. Die Top-Down-Sicht wird um eine Bottom-Up-Sicht ergänzt, in der aus Mitarbeitendenperspektive konkrete Optimierungsideen aus dem Tagesgeschäft abgeleitet werden. In einer sich anschließenden Konsolidierung und Priorisierung entsteht im Anschluss ein Use-Case-Backlog für das Unternehmen.

(1) https://arxiv.org/abs/2303.10130

Das Projekt erfolgt in enger Kooperation mit dem Projekt Generative KI in der Berliner Unternehmenslandschaft (BerGPT)

und dem Projekt Digital +

Englisch Version:

Implementation Model for Introducing Generative AI in SMEs

1. Discovering Phase:

2. Scoping Phase:

3. Piloting Phase:

4. Scaling Phase:

Training and Change Management Measures:

These measures accompany all phases, beginning with training for the executive management to familiarize them with the opportunities and limitations of AI. Subsequently, managers and the works council are involved. A cross-departmental AI team is formed, and open communication and participation are promoted through employee events and an AI marketplace. Before company-wide rollout, mandatory employee training is conducted to bring everyone up to speed.

Mit der KI-Werkstatt schafft die HTW Berlin einen Ort für das gemeinsame Forschen, Lehren und Anwenden von KI-Technologie auf aktuelle Praxisprobleme. Ziel ist u.a. die Schaffung einer hochschulweiten Infrastruktur, welche die Verwendung und Weiterentwicklung aktueller KI-Algorithmen auf höchstem wissenschaftlichem Niveau ermöglicht, sowie die Entwicklung eines KI-Modulbaukastens um die KI-Lehre interdisziplinär fördern.

Kontaktiere Uns